超大规模预训练模型是从弱人工智能向通用人工智能的突破性探索,解决了传统深度学习的应用碎片化难题,但性能与能耗提升不成比例的效率问题限制了参数规模继续扩张。人工智能研究将从大模型参数竞赛走向大小模型的协同进化,大模型向边、端的小模型输出模型能力,小模型负责实际的推理与执行,同时小模型再向大模型反馈算法与执行成效,让大模型的能力持续强化,形成有机循环的智能体系。

趋势解读

谷歌的BERT、Open AI的GPT-3、智源的悟道、达摩院的M6等大规模预训练模型取得了重要进展,大模型的性能有了飞跃性提升,为下游的AI模型提供了发展的基础。然而大模型训练对资源消耗过大,参数数量增加所带来的性能提升与消耗提升不成比例,让大模型的效率受到挑战。

大模型的参数规模发展将进入冷静期,大模型与相关联的小模型协同将是未来的发展方向。大模型沉淀的知识与认知推理能力向小模型输出,小模型基于大模型的基础叠加垂直场景的感知、认知、决策、执行能力,再将执行与学习的结果反馈给大模型,让大模型的知识与能力持续进化,形成一套有机循环的智能系统,参与者越多,受惠者越多,模型进化的速度也越快。

新的智能体系带来三个优势:一是让小模型更容易获取通用的知识与能力,小模型专注在特定场景做极致优化,提升了性能与效率;二是解决了过去大模型数据集过于单一的问题,小模型在真实场景回收的增量数据,让大模型有再进化的元素;三是全社会不需要重复训练相似的大模型,模型可以被共享,让算力与能源的使用效率最大化。

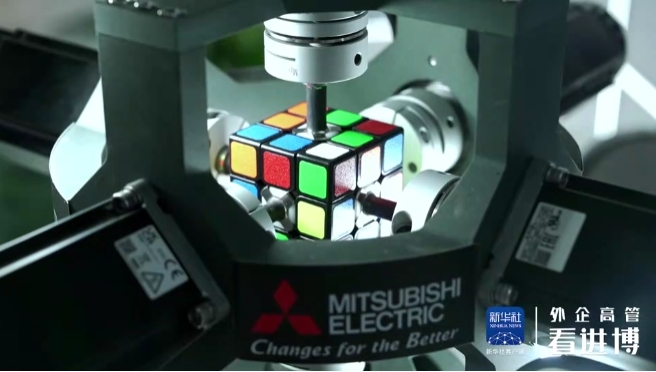

在协同进化的智能系统下,复杂系统内部可以更有机地融合,如城市治理的场景,大脑是治理中枢,边端是各路摄像头及边缘设备。边端的摄像头将看到的数据进行学习,将学习的结果反馈给治理中枢,治理中枢再赋能给其他类似场景的摄像头,形成有机进化的系统。

新的智能体系需要克服三个挑战,一是大模型与知识常识的融合,将以规则存在的知识利用起来,提升模型通用能力的同时也降低训练所需的数据量,让大模型从数据驱动走向知识与数据融合驱动;二是大小模型的协同机制,包含大模型的知识与能力向小模型降维迁移的有效性、小模型的小样本学习向大模型的升维融合、不同维度数据的清洗与治理等;三是大模型的可解释性,对大模型依赖上升的同时,信任决定是否能被广泛使用。

我们预测在未来的三年内,在个别领域将以大规模预训练模型为基础,对协同进化的智能系统进行试点探索。在未来的五年内,协同进化的智能系统将成为体系标准,让全社会能够容易地获取并贡献智能系统的能力,往通用人工智能再迈进一大步。

文章来源:达摩院DAMO

(转载)